データの海を自在に泳ぎ情報を武器に変える新しい知恵

現代のビジネスにおいて、「情報」は最大の資産です。競合他社の価格設定、SNSで話題のトレンド、最新の市場調査結果、あるいは投資判断に不可欠な統計データ。これらの情報はインターネットという巨大な海の中に無数に漂っています。しかし、その有益な情報を手に入れ、自分のビジネスや活動に活かすためには、これまでは膨大な「時間」と「労力」、あるいは高度な「プログラミング技術」が必要でした。

もし、あなたが毎日決まったウェブサイトをチェックし、そこにある情報をコピーしてエクセルに貼り付けるという作業を繰り返しているのなら、その時間はもっとクリエイティブな活動に充てられるはずです。そこで注目されているのが【Webスクレイピング】という技術です。これは、ウェブサイトから特定の情報を自動的に抽出して保存する手法を指します。

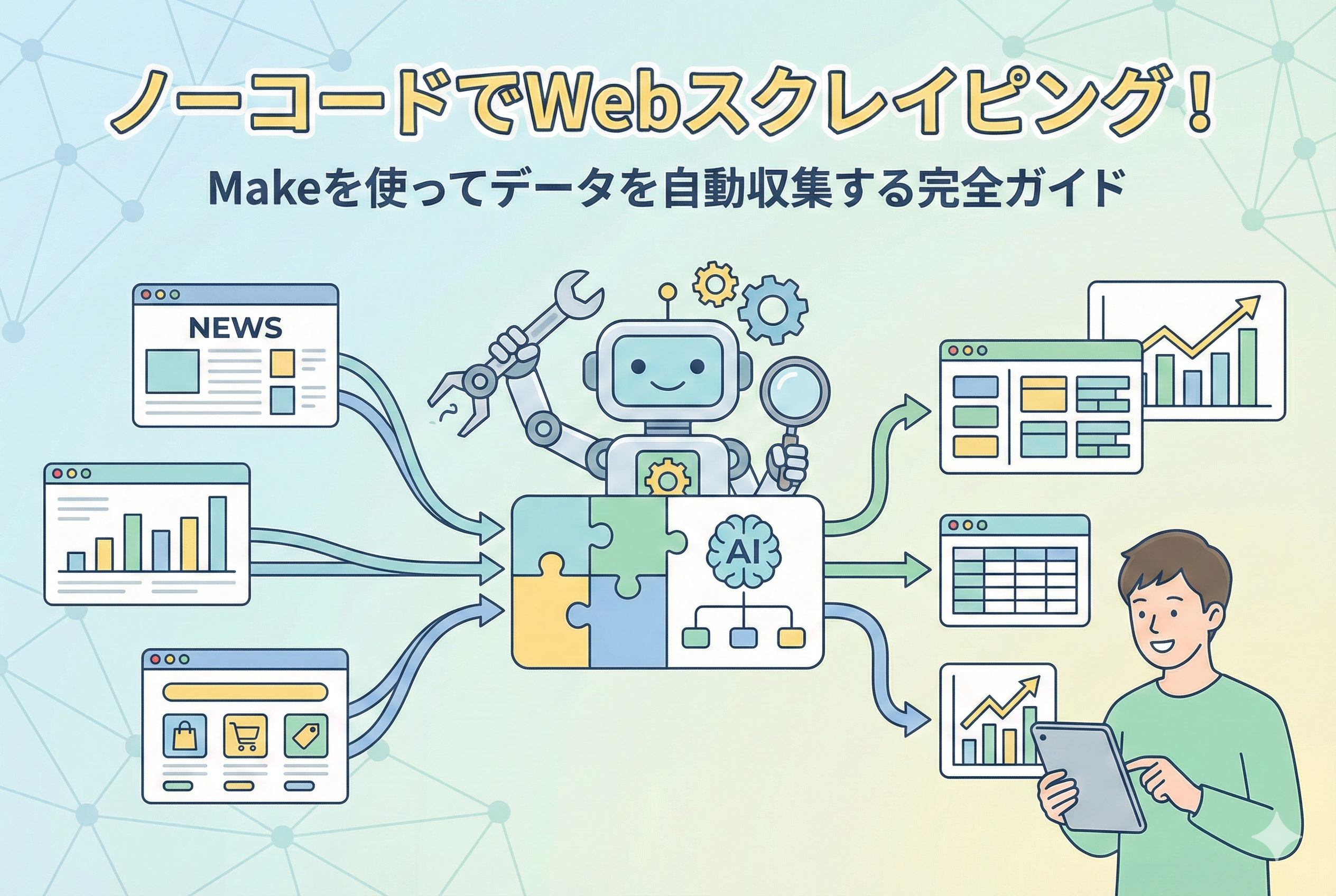

かつてはエンジニアの専売特許だったこの技術も、現在は「ノーコード」ツールの普及によって、プログラミングを一切学んだことがない方でも簡単に扱えるようになりました。特に、世界中で愛用されている自動化プラットフォーム【Make(メイク)】を活用すれば、驚くほどスムーズに、そして高度なデータ収集システムを構築することができます。本記事では、初心者の方に向けて、Makeを使った次世代のデータ収集術を詳しく解き明かしていきます。

情報を追いかけるあまり大切な時間を失っていませんか

情報を集めること自体は目的ではなく、あくまで「判断」や「行動」のための手段です。しかし、多くの方が「集めるプロセス」で力尽きてしまっているのが現状です。

手作業という名の終わりなき重労働

毎日特定のサイトを数分おきにリロードし、新しい投稿がないかを確認する。見つけたらコピーしてシートに貼り付け、書式を整える。こうした「コピペ作業」は、一つ一つは単純ですが、積み重なれば一日の数時間を奪い去ります。さらに、人間が行う以上、どうしても「入力ミス」や「漏れ」が発生してしまいます。情報の正確性が求められるビジネスにおいて、こうしたヒューマンエラーは致命的なリスクになりかねません。

専門知識という名の高い壁

「スクレイピングを自動化したい」と思っても、従来はPython(パイソン)などのプログラミング言語を習得するか、高額な専用ツールを導入するしかありませんでした。エンジニアに外注すればコストがかさみ、少しウェブサイトの仕様が変わるたびに修正費用が発生します。この「技術的なハードル」と「コストの壁」が、多くのフリーランスや中小企業のDX(デジタルトランスフォーメーション)を阻んできました。

鮮度という名の情報の価値

情報は鮮度が命です。競合が価格を下げた数時間後に気づくのと、数日後に気づくのでは、その後の戦略に雲泥の差が出ます。手作業に頼っている限り、情報の「同時性」を確保することは不可能です。寝ている間も、他の作業をしている間も、常に情報を監視し続ける仕組みがなければ、激しい変化の時代を生き抜くことは困難です。

このように、手動でのデータ収集は「時間」「正確性」「スピード」のすべてにおいて限界を迎えているのです。

結論:Makeで構築する「眠らない収集システム」

これらの問題を解決する決定的な手段が、【Makeを使ったノーコード・スクレイピング】です。結論から申し上げますと、Makeを活用することで、プログラミング知識ゼロの状態からでも、自分専用の「全自動データ収集ロボット」を数分で作り上げることが可能です。

Make(旧称:Integromat)は、異なるアプリやウェブサービスをパズルのように組み合わせて自動化を実現する「iPaaS(アイパース)」と呼ばれるプラットフォームです。これに、ウェブサイトの情報を読み取る「HTTPモジュール」や、情報を整理する「AIモジュール」を組み合わせることで、以下のようなワークフローが自動で完結します。

- 【指定した時間にサイトを訪問】:例えば1時間おきに自動でアクセス。

- 【必要な情報を抽出】:商品名、価格、投稿内容などを特定して取得。

- 【データを加工・保存】:スプレッドシートへの保存や、LINEへの通知。

Makeを導入することは、単なるツール選びではありません。あなたの代わりに24時間365日、休むことなく情報を精査し続ける「優秀なデジタル社員」を雇うことに等しいのです。これにより、あなたは情報の「収集」から完全に解放され、その情報をどう「活用」するかに全精力を注げるようになります。

なぜMakeがスクレイピングに最適なツールなのか

数ある自動化ツールの中でも、なぜMakeが最もおすすめなのか。それには、他のツールを圧倒する3つの理由があります。

1. 視覚的に「情報の流れ」を設計できる

Makeの最大の特徴は、その「視覚的な操作性」です。丸い「モジュール」と呼ばれるアイコンを線で繋いでいくだけで、データがどこから来てどこへ行くのかを一目で把握できます。プログラミングコードのような文字の羅列とは異なり、直感的にフローを作れるため、初心者でも「何が起きているか」を理解しながら構築を進められます。

2. 圧倒的な「拡張性」と「接続数」

Makeは1,000種類以上のアプリと連携できます。スクレイピングしたデータを、Googleスプレッドシートに保存するだけでなく、Notionにデータベース化したり、ChatGPTに渡して要約させたり、Slackに重要なものだけを投稿したりと、無限の組み合わせが可能です。スクレイピングは「取って終わり」ではありません。その後の「活用」までを一気通貫で自動化できるのがMakeの強みです。

3. コストパフォーマンスの高さ

専用のスクレイピングサービスは月額数万円することも珍しくありません。しかし、Makeは無料プランから始めることができ、個人利用や小規模なビジネスであれば、月額数千円程度の有料プランで十分すぎるほどのパワーを発揮します。自分で構築するため、外注費もかからず、仕様変更にも柔軟に自分で対応できるため、長期的なコストを劇的に抑えることができます。

従来の手法とMakeによる自動化の比較

スクレイピングの手法による違いを整理すると、以下のようになります。

| 比較項目 | 手作業(コピペ) | プログラミング(Python等) | Makeによる自動化 |

| 難易度 | 【誰でもできる】 | 極めて高い | 低い(ノーコード) |

| 作業時間 | 膨大 | 初期構築に時間がかかる | 短時間で構築可能 |

| 正確性 | 低い(ミスが多い) | 高い | 高い |

| コスト | 人件費が高い | エンジニア費用が高い | 安価(月額制) |

| 保守のしやすさ | 不要(ただし疲弊する) | 専門知識が必要 | 自分で修正可能 |

| 夜間の稼働 | 不可能 | 可能 | 24時間自動稼働 |

Makeを使ったデータ自動収集の基本ステップ

ここからは、具体的にどのような手順でスクレイピング・ワークフローを構築するのか、その構造を詳しく解説します。

ステップ1:トリガー(起動タイミング)を決める

自動化をいつ始めるかを設定します。Makeの「Watch」機能を使えば、「毎日午前9時に実行する」といった定期実行や、「特定のサイトが更新されたら即座に実行する」といった設定が可能です。

ステップ2:ウェブサイトの情報を取得する(HTTPモジュール)

次に、ターゲットとなるウェブサイトにアクセスする指示を出します。Makeの「HTTP」モジュールを使えば、プログラミングをしなくても特定のURLの情報を「読み込む」ことができます。ここでは、サイト全体のデータを一度丸ごと取得するイメージです。

ステップ3:必要なデータを抽出する(テキストパーサー)

読み込んだデータの中から、本当に欲しい部分だけを抜き出します。例えば、サイト全体のコードの中から「価格」の数字だけを取り出すといった作業です。これには「Text Parser(テキストパーサー)」という機能を使います。「〇〇という文字の次にある数字」といった指定をするだけで、AIのような賢さでデータを仕分けしてくれます。

ステップ4:保存先を指定する(Google Sheets / Notion等)

抜き出したデータを、使いやすい形に保存します。Googleスプレッドシートの各列に「タイトル」「URL」「価格」が自動で埋まっていく様子は、まさに魔法のように感じるはずです。

ステップ5:通知や連携を追加する

単に保存するだけでなく、「価格が〇〇円以下になったらLINEに通知する」といったフィルター機能を追加することも可能です。これにより、あなたは「重要な変化」が起きたときだけ、受動的に情報を知ることができるようになります。

Webスクレイピングを行う際に必ず守るべき「ルールとマナー」

スクレイピングは非常に強力な技術ですが、正しく使わなければ相手のサイトに迷惑をかけたり、最悪の場合は法的なトラブルに発展したりする可能性があります。初心者の方が安心して自動化を続けるために、必ず押さえておくべき3つのルールがあります。

サイトの利用規約と「robots.txt」の確認

すべてのウェブサイトには、そのサイトをどのように利用してよいかというルール(利用規約)があります。中には「自動ツールによるデータ収集を禁止」しているサイトもあります。まずは利用規約を確認しましょう。 また、ウェブサイトのURLの末尾に「/robots.txt」と入力してアクセスすると、そのサイトがクローラー(自動巡回ロボット)に対して、どのページの収集を許可し、どこを禁止しているかが書かれたファイルを確認できます。これらを確認し、禁止されている場所にはアクセスしないのが鉄則です。

サーバーに負担をかけないための「待機時間」の設定

スクレイピングは、人間が手でページを開くよりもはるかに速いスピードでアクセスが可能です。しかし、あまりにも短時間に大量のアクセスを行うと、相手のサーバーに過度な負担がかかり、サイトをダウンさせてしまう恐れがあります。 Makeでワークフローを組む際は、モジュールの間に「Sleep」という待機時間を挟む設定を入れたり、実行頻度を「1時間に1回」にするなど、常識的な範囲でのアクセスを心がけましょう。

著作権法とデータの取り扱いに関する注意点

収集したデータをどのように使うかも重要です。「自分だけで分析に使う(享受)」のであれば、日本の著作権法(第30条の4)でも柔軟に認められていますが、収集したデータをそのまま自分のサイトで公開したり、販売したりすると、著作権侵害になる可能性が高くなります。あくまで「自社の分析」や「効率化」のために活用することを意識してください。

Make×AI(ChatGPT/Gemini)でデータ収集をさらに進化させる

Makeの本当の恐ろしさは、スクレイピングで取ってきた「生データ」を、そのままAIに渡して加工させることができる点にあります。これにより、単なる「収集」が「インテリジェンスな分析」へと進化します。

収集したデータの「ゴミ」をAIで取り除く

ウェブサイトから情報を取ってくると、不要なタグや改行、広告のテキストなどが混じってしまうことがよくあります。これを人間が手で掃除するのは大変ですが、Makeのフローの中に「OpenAI(ChatGPT)」や「Google Gemini」のモジュールを組み込めば、「以下のテキストから商品名と価格だけを抽出して、きれいなリストにして」と頼むだけで、一瞬でデータが整理されます。

スクレイピングした内容を自動で「ポジネガ判定」や「カテゴリ分類」

例えば、自社製品に関するSNSの投稿や口コミをスクレイピングした場合、その内容が「喜んでいる声(ポジティブ)」か「不満の声(ネガティブ)」かをAIに自動判定させることができます。 そのままスプレッドシートに「感情スコア」として保存していけば、顧客満足度の変化をグラフで可視化することも容易です。また、大量のニュース記事をスクレイピングして、「不動産」「税務」「テクノロジー」といったカテゴリにAIで自動仕分けさせることも、Makeなら簡単です。

明日から使える!Makeを活用した3つの具体的な活用シーン

具体的な活用イメージを膨らませるために、フリーランスや個人ビジネスで特におすすめの活用例を3つご紹介します。

1. 競合他社の新着商品・価格変更の自動監視

ライバル店がいつ新商品を出し、いつ値下げをしたのか。これを毎日手動で見に行くのは苦行です。

- 【Makeのフロー】:1日3回、競合サイトのショップページを訪問 > 前回の価格と比較 > 変更があれば自分のLINEやSlackに「〇〇が1,000円値下げされました」と通知。 これにより、あなたは一歩も動かずに市場の動きを把握し、即座に自社の戦略を練り直すことができます。

2. SNSやニュースサイトからのトレンドキーワード収集

「今、何が話題になっているのか」をいち早く知ることは、コンテンツ制作や商品開発において不可欠です。

- 【Makeのフロー】:特定のニュースサイトやSNSのトレンド欄をスクレイピング > 頻出する単語をAIで抽出 > 注目すべきキーワードをGoogleドキュメントに週次レポートとして自動作成。 リサーチ作業をAIに任せることで、あなたは「どうすればそのトレンドに乗れるか」を考える時間に集中できます。

3. 不動産サイトや求人サイトの情報集約と整理

複数のサイトにまたがる情報を一つにまとめたい場合も、Makeが活躍します。

- 【Makeのフロー】:3つの不動産ポータルサイトから「新着のオーナーチェンジ物件」を取得 > 重複している情報を削除 > 収益性の計算(利回りなど)を自動で行い > 条件に合うものだけをNotionのデータベースに登録。 情報の「選別」まで自動化することで、お宝物件を見逃すリスクを最小限に抑えられます。

未来の自分に自由な時間をプレゼントするための最初のアクション

「難しそう」という先入観で立ち止まってしまうのが一番の損失です。Makeを使った自動化は、一度作ってしまえば、あなたが寝ている間も、旅行に行っている間も、24時間働き続けてくれます。最後に、今日からできる3つのアクションをご提案します。

ステップ1:Makeの無料アカウントを作成する

まずは「Make.com」にアクセスし、アカウントを作りましょう。Googleアカウントなどで簡単にサインアップできます。無料プランでも十分にスクレイピングのテストが可能です。まずは管理画面に入り、アイコンが並ぶ「シナリオ」の画面を眺めてみるだけでも、新しい世界への第一歩になります。

ステップ2:まずは「Googleニュース」など簡単なサイトで練習する

いきなり複雑な会員制サイトなどを狙うのではなく、構造が分かりやすい「Googleニュース」などで練習を始めましょう。 「最新の『AI』に関するニュースのタイトルを5件取ってくる」というシンプルな目標を設定します。HTTPモジュールでデータを読み込み、Text Parserでタイトルを抜き出す。この基本的な流れが成功したときの感動は、あなたのこれまでの「手作業」の概念を塗り替えてくれるはずです。

ステップ3:自動化の「小さな成功体験」を積み上げる

最初から完璧なシステムを目指す必要はありません。「1日1回、特定のサイトをチェックして自分にメールを送る」といった、5分で終わるような小さな自動化から始めてください。その「小さな時間の節約」が積み重なることで、次第により大きな、複雑なワークフローを構築する自信と技術が身についていきます。

AIとノーコードツールを使いこなすことは、現代における「最強のレバレッジ」です。情報の波に飲まれるのではなく、Makeという船を操り、情報を自在にコントロールする側に回ってください。あなたのビジネスは、その瞬間に劇的な進化を遂げるはずです。